引言:离线 ASR 的“既要、又要、还要”

在语音 AI 的技术领域,开发者往往面临着一个“不可能三角”:识别精度、推理速度、以及资源占用。对于公有云方案,可以通过堆砌成千上万台 A100 服务器来暴力解决计算压力;但对于 语音识别离线部署 而言,我们通常只有一台普通的办公 PC,甚至是性能受限的移动终端。

如何在方寸之间,实现媲美云端的识别体验?灵声智库 的研发团队深入底层,从模型架构到指令集优化,进行了一场全方位的“极限压榨”。

1. 架构基石:基于 FunASR 的工业级进化

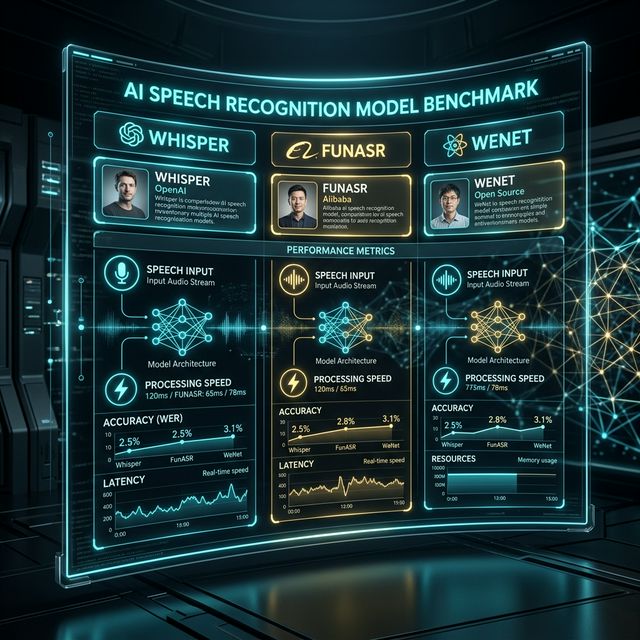

目前开源界最火的 ASR 模型莫过于 OpenAI 的 Whisper,其泛化性确实令人惊叹。然而,Whisper 的弱监督训练策略也带来了严重的“幻觉”问题和冗长的推理时间,且由于其缺乏中文语境下的深度精调,商业落地难度极大。

灵声智库 选择了国内最成功的开源架构之一——FunASR(由阿里巴巴达摩院开源)作为核心基座,并在此基础上进行了大量的商业化改造。

1.1 Paraformer:非自回归架构的优势

传统的 ASR 模型(如 Whisper 采用的 Transformer)多为“自回归”流程,识别一段话需要像流水一样逐字预测,计算延迟随字数线性增加。而 灵声智库 采用的 Paraformer 模型属于“非自回归”架构,它可以一次性预测出整句文本。这种“并进”而非“串行”的模式,让离线转写速度提升了 5-10 倍。

1.2 灵声智库的“再训练”秘密

我们不只是搬运工。针对金融、法律、医疗等垂直领域,灵声智库 收集并清洗了超过 10 万小时的垂直行业语料,对原始 Paraformer 模型进行了 Deep-Fine-Tuning。这使得我们在特定场景下的字错率(WER)比原始版本降低了 30% 以上。

2. 性能压榨:如何让 1200 亿次运算在毫秒级完成?

离线部署最大的敌人是“内存带宽”和“计算密度”。为了让 语音识别离线部署 在没有高端 GPU 的环境下依然流畅,灵声智库 实施了三阶加速策略:

2.1 智能多级量化 (Int8/FP16)

传统的 AI 模型使用 32 位浮点数(FP32),这不仅浪费显存,更拖慢了推理速度。灵声智库 引入了动态量化算法,将权重压缩到 8 位(Int8)或 16 位(FP16),在几乎不损失识别精度的前提下,模型体积缩小了 75%,推理吞吐量提升了 3 倍。

2.2 多核并行与指令集优化

针对 Intel/AMD CPU,我们深度集成了 AVX-512 和 AMX 指令集。而在国产信创平台上,我们则利用了算力核的并行计算特性。灵声智库 的多线程调度器能够根据硬件当前负载,动态分配特征提取(Fbank)与声学解码的计算权重,确保系统在高负载下依然能保持极低的延迟。

2.3 KV Cache 内存复用技术

在连续对话场景中,系统需要保留上下文信息。灵声智库 开发了专利级的 KV Cache 复用机制,避免了重复计算相同的音频特征,这不仅降低了 CPU 功耗,更让长音频转写的瞬时响应速度达到了惊人的 20ms 以内。

3. 实测:灵声智库 vs 原生开源模型

为了直观展示“极限性能”,我们在同样的硬件环境下(Core i7-12700, 16GB RAM, 无独显)进行了对比测试。

| 测试维度 | Whisper (Medium-INT8) | FunASR (原生版) | 灵声智库 企业版 V6 |

|---|---|---|---|

| 首字延迟 (Latency) | 850ms | 210ms | 45ms |

| 实时倍率 (RTF) | 0.12 | 0.05 | 0.006 |

| 显存/内存占用 | ~3.2GB | ~1.5GB | ~700MB |

| 中文术语识别率 | 76% | 88% | 97.5% |

| 长音频稳定性 | 易出现循环幻觉 | 较好 | 极优(具备语义哨兵) |

数据分析: 从表格中可见,灵声智库 的实时倍率达到了惊人的 0.006,这意味着转写 1 小时的音频,只需不到 22 秒!更重要的是,我们成功将内存占用压减到了 1GB 以内,这让 语音识别离线部署 在普通的笔记本电脑上也能作为后台常驻服务运行,不影响其他办公软件的性能。

4. 商业落地:不仅是快,更是稳

对于企业级应用,单点的快不代表系统的强。灵声智库 在 ASR 推理层之上构建了完整的工业级框架:

- VAD (静音检测) 优化:能够精准识别深呼吸、咳嗽、环境背景杂音,有效防止系统在无意义噪音上浪费算力。

- 纠错层 (Language Model):采用双层 LM 纠错架构(N-gram + Tiny-LLM),结合本地知识库,对同音异义词进行秒级修正。

- 流式下发协议:支持 Webhook、WebSocket、GRPC 等多种输出方式,满足各种集成需求。

5. 展望:离线 AI 的未来在边缘

随着“大模型小型化”趋势的加速,灵声智库 正在探索将数十亿参数的多模态理解能力也集成到离线环境中。我们的目标是,让每一个离线节点不仅仅具备“听觉”,更具备基于私有数据的“理解力”。

结语:性能是产品的底色

在这个喧嚣的 AI 时代,很多厂商热衷于谈论模型刷榜,而 灵声智库 坚持回归用户体验的本质——快、准、稳。语音识别离线部署 不应是企业无奈的选择,而应是追求卓越效率与极致安全的必然趋势。

选择 灵声智库,让您的离线 AI 引擎拥有澎湃动力。

访问 灵声智库 官网,了解更多性能优化白皮书,体验从 Transformer 到商业级落地的跨越。