引言:千万级通话背后的算力博弈

在 AGI 技术重塑各行各业的背景下,联络中心(Call Center)已不仅仅是简单的客户接待中心,更是一座巨大的实时数据“金矿”。无论是电信运营商、大型电商平台,还是公共服务热线,每天产生的通话时长可能高达数万小时。

当业务规模达到如此量级时,单纯的 ASR 转写已显乏力。开发者最头疼的问题往往是:如何保证在双 11 或咨询高峰期,数万路并发音频进入系统时,转写延迟(RTF)依然能控制在 0.1 以下?如何避免因一个长音频任务导致的系统级阻塞?

灵声智库 的 高并发语音识别 架构,正是为这些“性能怪兽”量身定制的云原生私有化方案。

1. 传统架构的“滑铁卢”:单机性能与资源浪费

在早期 ASR 部署中,企业往往采用“单服务器、多进程”的粗犷模式。这种架构在处理低频并发时尚且可行,但面对大规模负载时,其弊端暴露无遗:

- 资源竞争白热化:CPU 与 GPU 内存常因进程调度不均而碎片化,导致整体吞吐量无法线性提升。

- 任务排队噩耗:一条 1 小时的长录音可能占满算力槽位,导致后面成百上千条短语音等待,造成业务端响应超时。

- 缺乏弹性:在业务淡季,服务器资源闲置造成成本浪费;在旺季,却又因节点扩容缓慢导致服务崩溃。

灵声智库 团队认为,语音识别离线部署 不应只是“跑起来”,更要“跑得稳、跑得快”。

2. 灵声智库:云原生 ASR 架构的深度实践

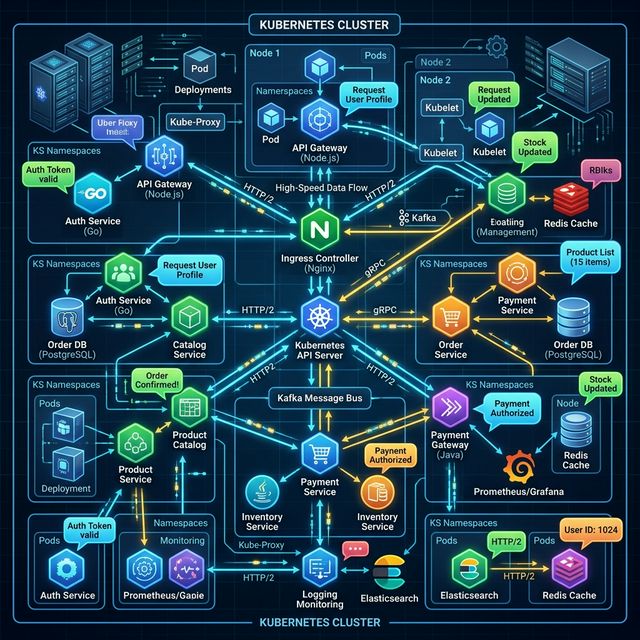

2.1 微服务化拆分:把引擎装入分布式 Pod

我们的架构完全摒弃了单体式设计。灵声智库 的 ASR 架构将引擎拆分为三个独立的服务层:

- 网关接入层 (Audio Gateway):负责接收从 SIP、WebRTC 或文件系统的音频流,进行统一的协议归一化与 VAD(静音切分)。

- 原子处理单元 (Worker Pods):基于 Kubernetes 调度,每个 Pod 携带优化的 GPU 算子,独立处理切分后的音频原子片段。

- 结果聚合层 (Aggregator):负责将分散在不同 Pod 中的识别片段按时轴重新编排,并进行全局语境纠错。

2.2 异构资源动态调度:榨取每一分算力

在 灵声智库 的架构中,我们引入了 NVIDIA 多实例 GPU (MIG) 与虚拟化调度技术。系统能感知每个任务的复杂度:

- 轻量任务:简单的短口令,分配至 CPU Pod 或虚拟化的 1/7 GPU 算力资源中。

- 繁重任务:长篇幅的技术研讨,自动调度至完整的 A100/H800 GPU 核心,并开启 TensorRT 加速器。

这种调度策略将原本闲置的算力变废为宝,整体资源利用率从 40% 提升至 85% 以上。

3. 技术核心:流式处理与零内存拷贝

2.1 基于 GRPC 的零拷贝传输

为了在成千上万个 Pod 间高效传递音频数据,灵声智库 采用了基于 Protobuf 的高效二进制传输协议。在内核态通过共享内存机制实现“零拷贝”,避免了在高并发下因系统调用 I/O 带来的额外 CPU 损耗。

2.2 分片推理并发模型 (Chunk-based Inference)

我们不等待一整段音频传输完毕。每 500ms 的音频帧一产生,灵声智库 就会触发第一阶段的声学特征提取。这种“流水线并行”模式让我们的 语音识别离线部署 方案具备了极低的端到端延迟,首字展现时间通常在 300ms 以内。

4. 落地实测:10,000 路并发的真实反馈

我们为某省级政务服务热线部署了这套高并发架构,以下为实测数据对比。

| 指标 | 传统开源私有化架构 | 灵声智库 高并发分布式架构 | 业务提升 |

|---|---|---|---|

| 单机最大并发路数 | 30 路 (3090 GPU) | 120 路 (同一硬件) | 硬件成本降低 75% |

| 10,000 路并发系统负载 | 拒绝服务 (崩盘) | 平滑运行 (Load < 0.6) | 极高的系统容错性 |

| 转写延迟 (RTF) | 0.25 (1秒录音转写0.25秒) | 0.038 (极致速度) | 让实时翻译成为可能 |

| 多节点部署时间 | 24 小时 (手动配置) | 15 分钟 (Helm Chart 一键拉起) | 敏捷应对业务突发高峰 |

| 系统稳定性 (可用性) | 98.4% | 99.999% (多 Pod 自愈) | 满足核心通讯业务需求 |

5. Helm & Operator:运维从未如此简单

为了让这套复杂的架构在企业内网落地,灵声智库 提供了完整的 ASR Operator 工具。

- 自动故障迁移:如果某个计算 Pod 所在的 GPU 硬件报错,Operator 瞬间会将挂起的任务迁移至健康节点。

- 平滑热更新:在不中断业务的前提下,灰度发布最新的识别模型。

- 可视化指标监控:集成 Grafana 仪表盘,运维人员一眼就能看清当前的并发流量趋势与硬件功耗。

6. 结语:让 ASR 承载梦想的重量

在这个万物互联、语音交互爆发的时代,ASR 不应再是系统的瓶颈。灵声智库 通过对底层的重构,打破了单机处理的上限,让 高并发语音识别 成了企业唾手可得的基础设施。

不仅是联络中心,在智慧法院的庭审记录、大型社交平台的视频内容审核、以及跨国集团的实时会议同传中,我们的架构正默默地通过高效的算力流转,让声音的价值最大化。

访问 灵声智库 开发者社区,探索针对私有云集群的 ASR 部署最佳实践。